Dans la région EMEA, la grande majorité des collaborateurs continuent d’utiliser les solutions d’Intelligence Artificielle générative (genAI) de manière ad hoc, à la demande, parfois sans en informer leur hiérarchie ou le service informatique.

Si l’impact est globalement positif sur leur productivité, les problèmes liés à la confidentialité des données et aux « hallucinations » des chatbots IA posent un risque juridique, financier et réputationnel pour leurs entreprises…

L’IA dans l’entreprise, ou la notion de « sandwich technologique »

Avec l’essor de l’IA et la multiplication des données dans toute l’entreprise, ces ressources ne sont plus uniquement centralisées sous le contrôle du service informatique. L’enquête de Gartner révèle qu’en moyenne, seulement 35 % des capacités en IA des entreprises seront développées par leurs équipes IT, le reste étant utilisé de manière ad hoc à l’échelle de chaque collaborateur, parfois sans la connaissance de sa hiérarchie.

De nouvelles approches sont donc nécessaires pour gérer et protéger l’accès aux données, superviser les entrées et sorties de l’IA et encadrer la valeur ajoutée apportée par la technologie pour éviter les risques juridiques mais aussi réputationnels.

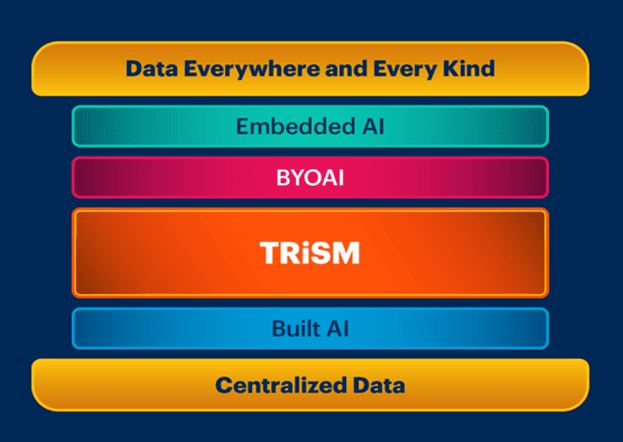

« C’est là qu’intervient le concept de ‘sandwich technologique’ », explique Daryl Plummer, VP Analyst chez Gartner, en décrivant l’architecture technologique future de l’IA (voir schéma suivant).

À la base du sandwich se trouvent la Data collectée (en général) et les solutions IA développées ou validées par le service informatique de l’entreprise. Au sommet, les données et les solutions IA provenant de sources diverses, souvent décentralisées, à l’échelle du collaborateur. Entre les deux, on retrouve les technologies dites TRiSM qui sécurisent l’ensemble.

Concept popularisé par Gartner, le TRiSM, ou « AI Trust, Risk, and Security Management », est un framework qui cherche à assurer la confiance, la gestion des risques et la sécurité dans les modèles d’intelligence artificielle (IA) utilisés dans l’entreprise. Cette couche intermédiaire permet d’intégrer l’IA et les données qui proviennent de sources externes.

La mission des DSI, notamment dans les grandes entreprises, sera donc de concevoir un sandwich technologique capable de gérer la complexité de l’IA tout en restant ouvert aux opportunités.

L’impact de l’IA sur les collaborateurs : entre ressentiment et engouement

L’IA peut susciter des réactions contrastées parmi les employés. Certains y voient un atout, tandis que d’autres se sentent menacés ou éprouvent un certain ressentiment à l’égard de cette technologie.

Ces sentiments forts peuvent entraîner des comportements inattendus qui nuisent à la performance au travail, « comme la jalousie envers ceux qui utilisent l’IA ou une dépendance excessive aux outils automatisés », explique Gartner.

Peu d’entreprises gèrent activement ces conséquences humaines. Toujours selon Gartner, seulement 13 % des DSI de la région EMEA œuvrent pour l’atténuation des impacts négatifs potentiels de l’IA générative sur le bien-être des équipes.

« La plupart des entreprises ne s’interrogent pas suffisamment sur l’effet de l’IA sur leurs employés », commente Alicia Mullery, VP Research chez Gartner. « C’est pourtant très important, car l’IA peut entraîner des comportements indésirables. Si vous mobilisez la gestion du changement pour aborder ce sujet, il est important de définir clairement les responsabilités de chacun face à ces comportements. Les organisations doivent gérer les aspects humains avec autant de rigueur que les résultats commerciaux. »